Podrías ser un robot. Esto no es una broma

Se habla mucho sobre la convergencia entre personas y robots. Como algunos lo ven, el aumento de la inteligencia artificial hará que los humanos se vuelvan obsoletos, o al menos obligará a las personas a pensar más como máquinas.

Si esta profecía debe verse como auspiciosa o amenazante es objeto de mucha especulación y controversia. Pero no se puede negar que de manera significativa, ya está sucediendo.

Artículo al respecto

Como los estudiosos jurídicos de la Universidad de Stanford Bryan Casey y Mark Lemley lo pusieron de manera provocativa en el título de un nuevo artículo que se publicará en Cornell Law Review, «Usted podría ser un robot«. No quieren decir eso literalmente, pero lo dicen en serio totalmente. «Si estás leyendo esto, (probablemente) no eres un robot«, escriben, «pero ciertas leyes podrían ya tratarte como tal«.

El problema, explican Casey y Lemley, es que definir lo que significa ser un «robot» manejado por «inteligencia artificial» es terriblemente difícil.

Puede ser fácil identificar a Optimus Prime cuando está en modo de batalla, pero supongamos que se transforma en un camión y te subes al asiento delantero. ¿Eres ahora el conductor? Podría ser: las leyes a veces definen a los conductores como una función dónde se sientan las personas, en lugar de si realmente están guiando el automóvil. Y eso significa que tendrá responsabilidad cuando Prime ejecute algunos Decepticons.

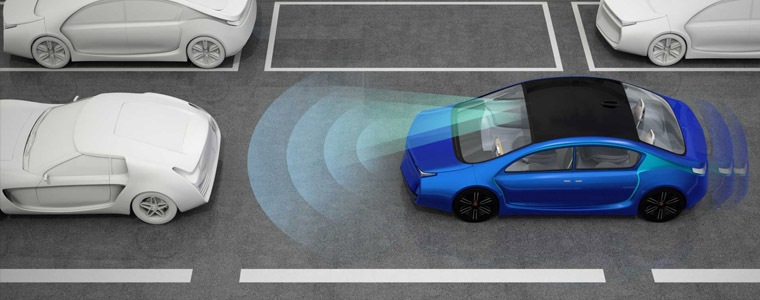

El ejemplo de Transformers no está lejos de lo que ya está sucediendo en el mundo de los vehículos que se conducen por sí mismos. Hay preguntas reales, digamos, acerca de si una persona que está dormida en un vehículo completamente automatizado es responsable si el automóvil atropella un peatón.

¿Dónde está el límite?

¿Dónde está el límite?

Las líneas se desdibujan así todo el tiempo. ¿Un robot pilotado por un humano es un robot con fines legales? ¿Qué pasa con un conductor humano que se basa en la guía de ruta de un teléfono inteligente?

Incluso si los estudiosos legales pudieran ponerse de acuerdo sobre cómo distinguir a los humanos de las máquinas, es poco probable que las definiciones precisas hagan frente al ritmo del cambio técnico. Algunos estados, por ejemplo, tienen leyes que exigen que todos los coches tengan conductores. Eso supuestamente tenía sentido cuando solo los humanos podían conducir, pero ahora significa que las compañías tienen que colocar a los humanos en los asientos del conductor de cualquier automóvil que prueben.

Una definición legal de inteligencia artificial que capturara perfectamente el campo de la IA tal como existe hoy probablemente sería inútil por el próximo avance tecnológico.

Si las leyes definieran la inteligencia artificial tal como existía hace una década, probablemente no habrían cubierto las redes neuronales de la actualidad, que se utilizan para enseñar a las máquinas a reconocer el habla y las imágenes, a identificar los productos farmacéuticos candidatos y a jugar juegos como Go.

Si los académicos y los legisladores, en cambio, recurren a definiciones amplias destinadas a cubrir desarrollos imprevistos, podría haber consecuencias no deseadas desagradables.

Como señalan Casey y Lemley, “una cantidad sorprendentemente grande de refrigeradores” son técnicamente “computadoras de interés administrativo” según un estatuto de ciberseguridad de la década de 1980 que no anticipaba el alcance de las computadoras. Este tipo de cobertura excesiva puede estrangular la innovación, ya que obliga a las personas a desarrollar nuevas tecnologías a preocuparse por una red de regulaciones que probablemente no deberían aplicarse a su trabajo, pero que sin embargo lo hacen.

¿Cuál es la solución?

Entonces, ¿cuál es la salida? Casey y Lemley sugieren buscar consejo en uno de los primeros eruditos de la inteligencia artificial, Alan Turing. Turing sugirió una prueba funcional: una máquina es «inteligente» siempre que su comportamiento sea indistinguible del de un humano.

Del mismo modo, las leyes podrían regular los robots en función de las acciones, en lugar de la forma en que están construidos. Por ejemplo, en lugar de tratar de descubrir qué tan «robótico» es un automóvil, las reglas de la carretera podrían depender de medidas funcionales como la seguridad.

También es importante aceptar la dificultad de definir robots, en lugar de tratar de solucionarlo. Siempre que sea posible, las leyes de la robótica deben definirse de manera inductiva, utilizando enfoques caso por caso. El cumplimiento debe delegarse a los reguladores, que pueden adaptar la implementación de manera más flexible que los legisladores.

De lo contrario, podríamos encontrarnos con normas que no pueden distinguir a los humanos de los Cylons. Esas no son las leyes que estamos buscando.

¿Dónde está el límite?

¿Dónde está el límite?